Vocal Editing: Im zweiten Teil des Workshops habt ihr erfahren, welche Vorgehensweisen die Aufnahme von Gesang aus technischer und künstlerischer Sicht begünstigen. Der dritte Teil thematisiert die verschiedenen Schritte der Nachbearbeitung. Diese sind praktisch immer erforderlich , um zu einem professionellen Ergebnis zu gelangen. Im Wesentlichen entspricht dabei die Gliederung auch der Reihenfolge der Bearbeitung.

Comping: Es kann nur einen (Vocal Take) geben!

Comping ist der inzwischen etablierte Begriff für den Schnitt der in der Produktion verwendeten Spur(en) aus allen aufgenommenen Takes. Die Gründe für diesen Nachbearbeitung variieren – je nach Qualität der Aufnahmen – von Schadensbegrenzung bis hin zur kreativen Formung der Gesangsperformance.

Dass es sich hierbei um keine reine Errungenschaft der Neuzeit handelt, offenbaren deutlich hörbare Schnitte und “Drop-ins” von Solo-Gesangsspuren legendärer Künstler aus der Prä-Computer-Ära, welche mir in der Vergangenheit für Remixe oder andere Aufgaben vorlagen.

Die meisten DAWs bieten hierzu bereits verschiedene “Comp-Funktionen” an, welche meines Erachtens mal mehr, mal weniger gelungen sind. Ob man diese oder einen anderen Workflow nutzt, ist jedem selbst überlassen.

Mein Workflow mit Logic & Pro Tools

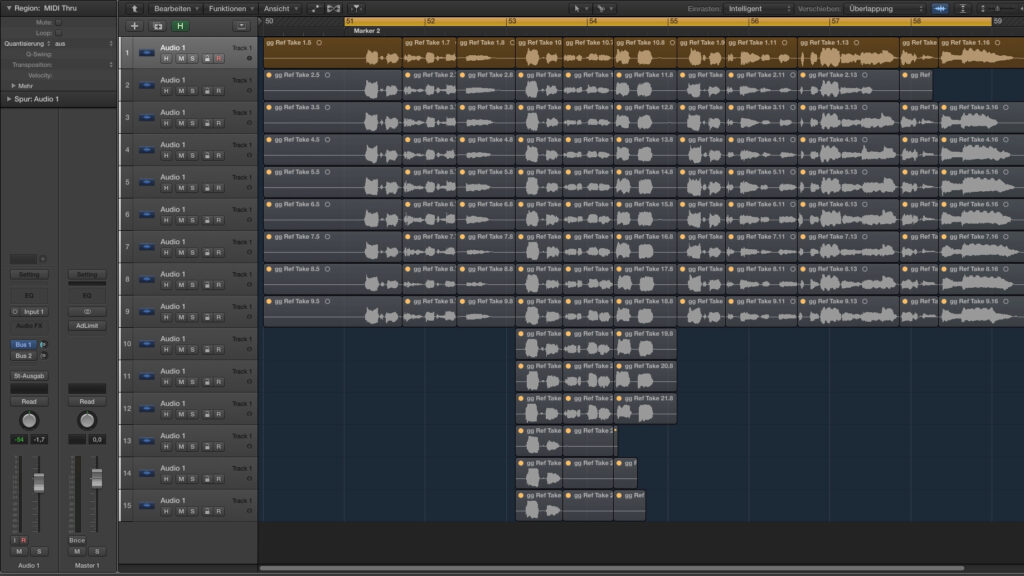

Im Folgenden beschreibe ich meinen persönlichen Comping-Workflow mit den DAWs Logic und Pro Tools. Aufgrund einer eventuell hohen Anzahl an aufgenommenen Takes sieht das Arrangement Fenster oftmals sehr chaotisch und unübersichtlich aus.

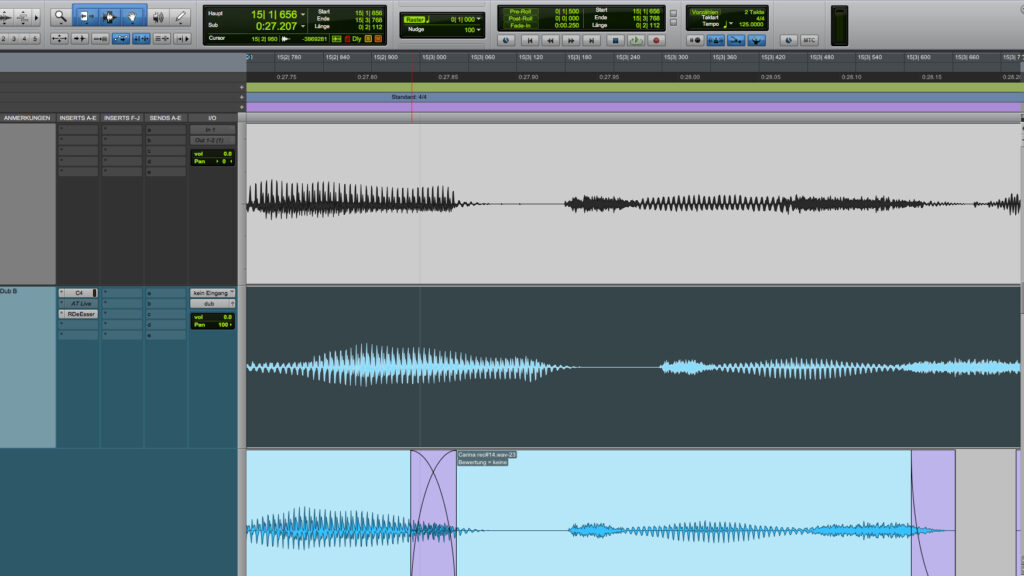

Man muss also vor der eigentlichen Arbeit noch etwas Ordnung und System in das zu bearbeitende Material bringen. Die folgenden Abbildungen dokumentieren, wie man durch einige Schnitt- und Schiebe-Aktionen die Takes kompakt anordnet. So hat man einen guten Überblick über alle Audio-Regions, ohne großartig scrollen zu müssen.

Wenn dies getan ist, beginne ich, alle Takes gemeinsam in kleine Häppchen zu zerschneiden. Diese Schnitte wähle ich in erster Linie nach der Grafik aus. Schnitte erfolgen also dort, wo Atmer oder kurze Gesangspausen dies problemlos ermöglichen. Aus musikalischer Sicht können diese unter Umständen recht willkürlich sein.

“Esoterisches Arbeiten”, wie beispielsweise die Auswahl komplett gesungener Strophen oder anderer Songteile aus Gründen vermeintlicher Authentizität betrachte ich als unprofessionell. Das führt nur in absoluten Ausnahmefällen zu einer guten Performance!

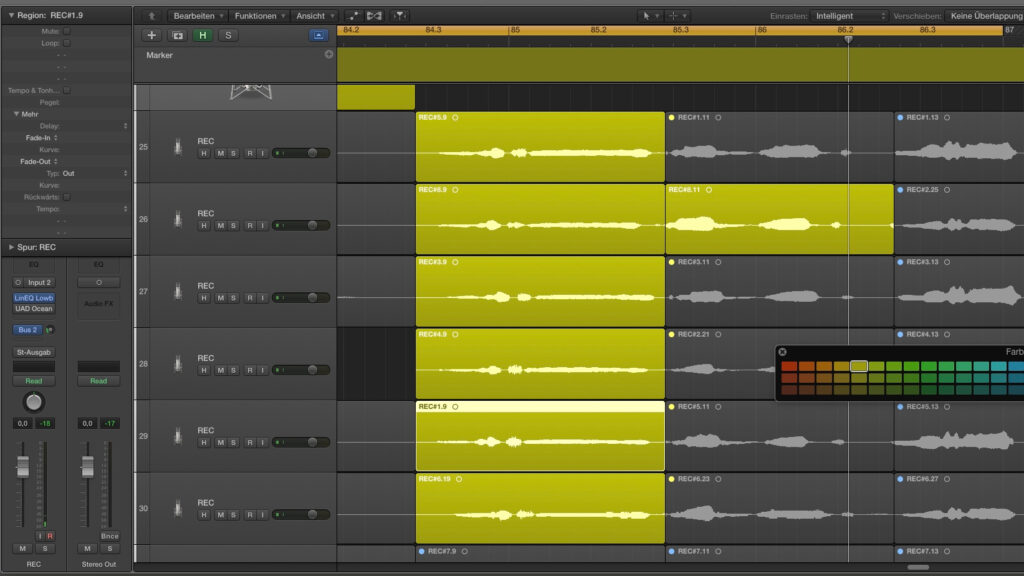

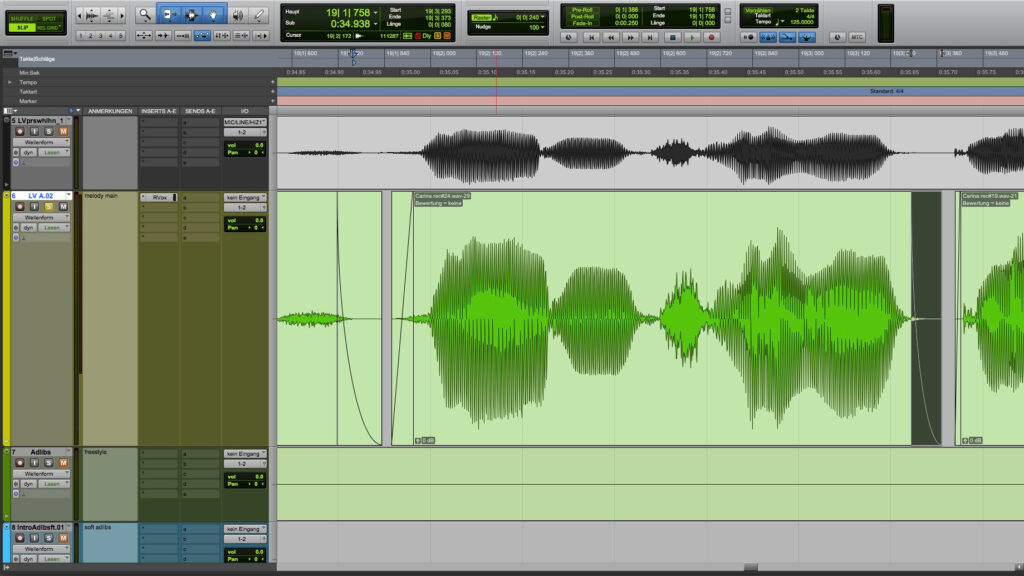

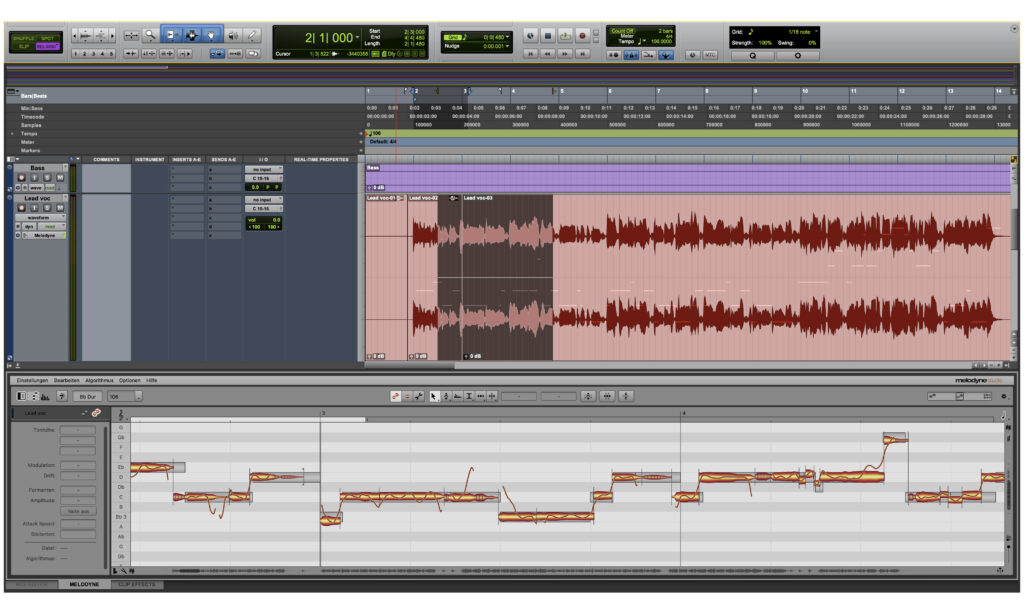

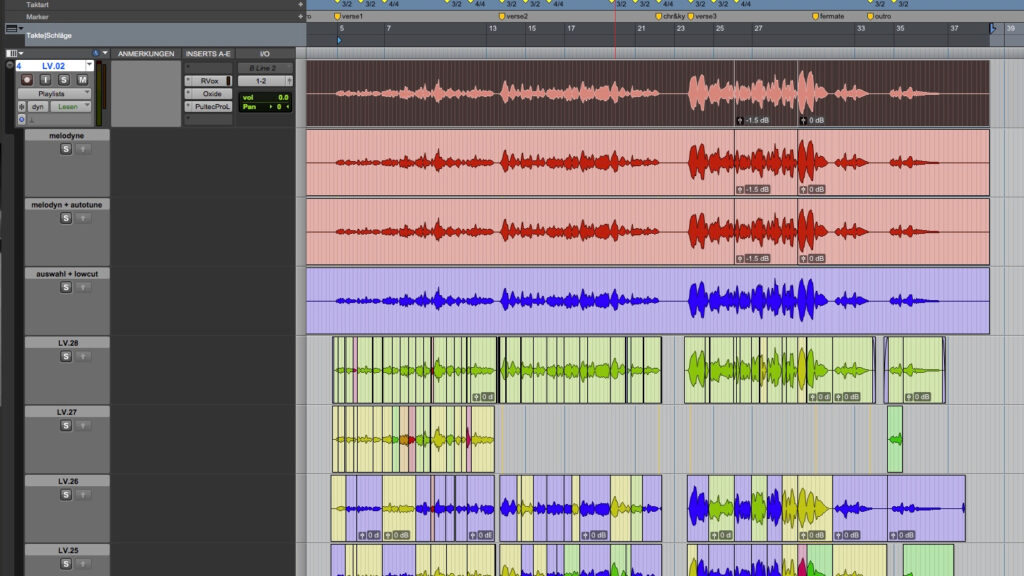

Willkommen in der Matrix

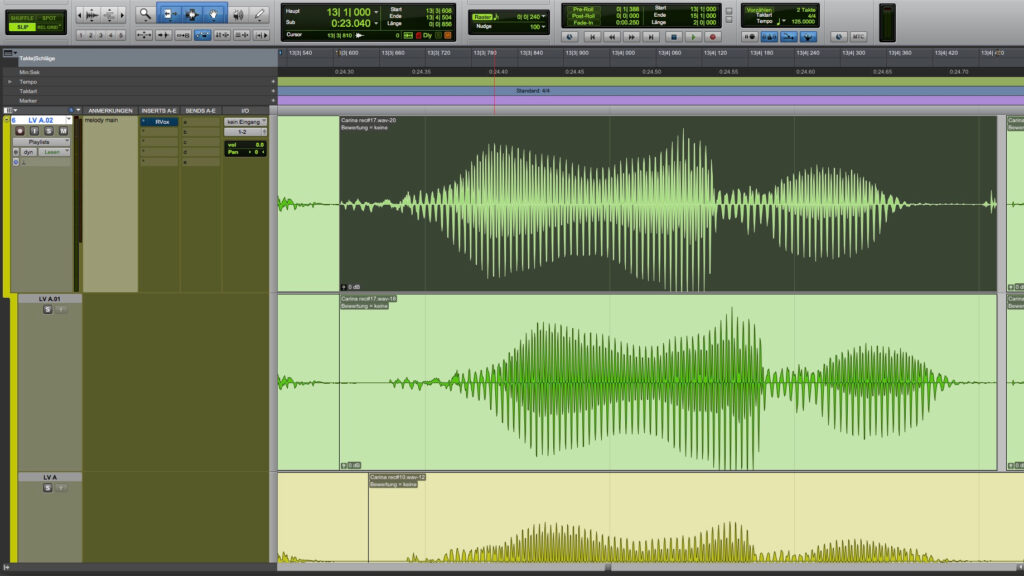

Das Ergebnis dieser Vorarbeit gleicht einer Matrix, welche es mir zügig ermöglicht, die untereinanderliegenden Audioregionen (Clips, Regions) nacheinander anzuhören und zu beurteilen. Die folgenden Abbildungen zeigen diesen Arbeitsschritt in Pro Tools und in Logic. In Letzterem konnte ich mich nie wirklich mit der Comping-Funktion anfreunden und nutze seit jeher Kopien derselben Audiospur für alle Takes. In Pro Tools hingegen kommt die entsprechende Funktion bei mir häufig zur Anwendung.

Der folgende Clip veranschaulicht das prinzipielle Vorgehen beim Comping in Pro Tools.

Aber wonach beurteile ich eigentlich die einzelnen Takes? Jede Auswahl ist natürlich subjektiv, dennoch finden sich im Folgenden auch einige objektive Auswahlkriterien:

- Korrektheit der Melodie und des Textes

- Intonation

- Sprachverständlichkeit

- Sound, “technisch” (Übersteuerungen, Störgeräusche, partiell ungünstige Position zum Mic etc.)

Etwas subjektiver wird es bei der Auswahl nach den folgenden Kriterien:

- “Ausdruck” (z.B.: Passt der Power-Gesang zum fragilen Textinhalt oder umgekehrt?)

- Klang der Stimme (hauchig, präsent, gepresst, souverän, zerbrechlich, Bruststimme, Kopfstimme, etc.)

- Rhythmus und Groove

- Art und Authentizität der Aussprache

- musikalische Details (Ansinger, Glides, Vibrato, kleine “Schlenker”)

Grob Anpeilen hilft

Die Entscheidung, ob sich eine Audioregion gut zur Verwendung in der Produktion eignet, fällt also generell aufgrund der genannten Kriterien. Die Erfahrung hat mich gelehrt, dass es während des Compings manchmal sinnvoll ist, bereits eine automatische Tonhöhenkorrektur zu aktivieren. Hierzu verwende ich den Klassiker schlechthin: Antares Auto Tune (automatischer Modus).

Diesen Schritt zähle ich noch nicht zur Tonhöhenkorrektur, er ist eher provisorischer Natur, um falschen Entscheidungen beim Comping entgegenzuwirken. Schief gesungene Töne wirken in der Regel plakativ und abtörnend.

Sie könnten davon ablenken, dass diese Region in Bezug auf Ausdruck, Stimmsound, Authentizität und dergleichen das Beste ist, was zu Verfügung steht und somit vielleicht die optimale Wahl ist!

Weiterhin füge ich häufig noch einen Kompressor und etwas Hall hinzu, um ein etwas repräsentativeres Bild davon zu erhalten, wie die entsprechenden Audioregionen in einer Produktion klingen würden.

Meine konkrete Vorgehensweise beim Vocal Comping

Zum Abhören der untereinanderliegenden Audioregionen setze ich einen Cycle mit etwas Vorlauf über die Region und höre mir alle nacheinander an. Wenn mir eine Audioregion gefällt, markiere ich sie, indem ich sie einfärbe oder ihr eine Schulnote gebe, wie hier in Pro Tools zu sehen ist:

Die Auswah läuft in etwa so ab wie die K.o.-Runde bei einer Fußball-Weltmeisterschaft. Alle markierten Regions werden erneut angehört, weitere Markierungen erfolgen, bis am Ende nur eine Audioregion stehen bleibt.

Tipp: Wenn man besonders viele Takes hat, ist es sinnvoll, vorausgewählte Regions neu untereinander zu formieren, um ohne zu scrollen den Überblick zu behalten!

Nach diesem Prinzip fährt man chronologisch mit der Auswahl der zeitlich aufeinanderfolgenden Regions fort, wodurch ein neues Kriterium hinzukommt: “Passt das oder hört es sich geschnitten an?”

Diese Gefahr besteht natürlich, wenn man alle Takes so brutal zerhäckselt, wie es meine Angewohnheit ist. Tatsächlich passen manchmal bevorzugte Regions nicht zusammen – doch wo ein Wille ist, ist meistens auch ein Weg! Wenn sich der Zusammenschnitt von zwei Audio Regions unnatürlich anhört, sind die Gründe hierfür meistens banal:

- Lautstärkeabweichung

- keine hundertprozentige Übereinstimmung des Timings

Ein simpler grafischer Vergleich mit der ungenutzten Region des zuvor verwendeten Takes ist häufig ein guter Hinweis, ob eine Anpassung per Region Gain (Clip Gain) oder eine erste Timingkorrektur durch Schieben (ggf. weitere Schnitte) hier unkompliziert Abhilfe verschafft.

Angleichen mit Match EQ

Glücklicherweise funktioniert dies in vielen Fällen! Falls man noch nicht zum erwünschten, natürlich klingenden Ergebnis gelangt, liegt dies vielleicht am Sound. Der Grund könnte eine variierende Position zum Mikrofon während der Aufnahme sein. In einigen Fällen hilft der Angleich per EQ – ein Spezialist für solche Fälle ist der Match EQ von Logic.

Wenn man sich auf diese Weise bis zum Ende des entsprechenden Parts (z.B. Lead Vocal, Vers 1) durchgekämpft hat, sollte man an dieser Stelle ggf. noch überprüfen, ob es störende Konsonanten, Plopplaute oder sonstige Fehler gibt, die man während dieses Arbeitsschritts schon austauschen könnte. Falls erforderliche Korrekturen des Timings durch simples Verschieben von Regions (möglicherweise inklusive einfacher Schnitte) machbar sind, führe ich dies bereits in diesem Arbeitsschritt durch. Das bedeutet nicht, dass an späterer Stelle keine weiteren Timing-Editierungen mit geeigneteren Tools erfolgen.

Der Feinschnitt meiner Auswahl erfolgt immer ganz am Ende dieses Arbeitsabschnitts, wenn ich mir bezüglich der verwendeten Regions ganz sicher bin. Hier habe ich den Ehrgeiz, dass man auch beim Abspielen der Gesangsspur in Solo keine Schnitte hört. Wer sich darauf verlässt, dass ein durchgehender Beat genügend Verdeckungseffekte erzeugt, um schlechte Schnitte zu kaschieren, könnte vielleicht eine böse Überraschung erleben. Zum Beispiel, wenn der Gesang im finalen Mix oder im Mastering eine deutliche Präsenzanhebung erfährt oder auf Weisung (Plattenfirma, Künstler, Akustikversion) verdeckende Elemente im Playback auf einmal wegfallen.

Faustregeln für einen gelungenen Schnitt

- Nach Möglichkeit sind Schnitte an gesangsfreien Stellen zu setzen.

- Man sollte vor oder nach, aber nicht während einer Atmung schneiden. Hinter einem Atmer zu schneiden ist die optimale Wahl wegen eventuellem Nachhall des Raums von der zuvor gesungenen, ggf. nicht verwendeten Phrase (ein bisschen nerdy, kann aber von Vorteil sein).

- Schnitte sind mit geeigneten Fades zu kaschieren.

- Konsonanten am Wortende sind wegen der Sprachverständlichkeit stets zu beachten.

- Schnitte innerhalb einzelner Silben sind nach Möglichkeit zu vermeiden, aber manchmal notwendig. Hier sind in der Regel Tüfteleien mit unterschiedlichen Fadekurven/-längen notwendig. Pro Tools begünstigt ein samplegenaues Editieren, wodurch sich manchmal fantastische Ergebnisse ganz ohne Fades/Crossfade erzielen lassen.

- Wenn sich ein auffälliger Schnitt aus künstlerischer Sicht nicht vermeiden lässt, sind zur Auswahl des Schnittpunkts nach Möglichkeit Verdeckungseffekte (gut geeignet: Drumsounds auf geraden Zählzeiten) zu nutzen.

Wenn es an den erfolgten Schnitten und Fades nichts mehr zu bemängeln gibt, bounce ich den Comp als neues Audiofile. Hierzu deaktiviere ich eventuell verwendete Kompressoren, provisorische Tonhöhenkorrekturen und auch den Hall. Allerdings aktiviere ich zum Bouncen häufig einen weiteren Lowcut. Trotz bereits aufnahmeseitig verwendeter Lowcuts besteht im Frequenzkeller immer noch genügend Bedarf für Aufräumarbeiten.

Gerne verwende ich steilflankige und phasenlineare Filter, die in der Regel effektiver arbeiten als die gängigen Lowcuts in Mikrofonen oder Preamps. Die Einsatzfrequenz bestimme ich grundsätzlich per Gehör, wobei ich mir auch gerne zusätzlich von einem Analyzer helfen lasse, um tieffrequente Probleme ausfindig zu machen.

Tonhöhenkorrektur von Gesangsspuren – Ein “Schief” wird kommen!

Die Korrektur der gesungenen Tonhöhe ist mittlerweile in allen Musikstilen üblich – ob es einem gefällt oder nicht. Prominente Künstler, die sich diesen Bearbeitungsmöglichkeiten verweigern (leicht herauszuhören bei Alicia Keys), bilden die absolute Ausnahme (ein geschmackloser und stilistisch unpassender Einsatz in verschiedenen Musikrichtungen leider nicht…). Allerdings bin ich ebenfalls der Meinung, dass jede Gesangsperformance von einer dem Stil entsprechenden Tonhöhenbearbeitung profitiert.

Zunächst sollte man die Abhörbedingungen für diesen Arbeitsschritt optimieren, sprich geeignete Lautsprecher oder Kopfhörer verwenden. Abhörwerkzeuge mit “Badewannen-Frequenzgang” verschleiern die Tonalität und sind nicht optimal. Gut hingegen eignen sich “mittige” Abhören, wie der der legendäre Yamaha NS-10 Lautsprecher. Nicht wenige Produzenten/Engineers erledigen diesen Arbeitsschritt über ihre Macbook Lautsprecher – kein Scherz! Diese entlarven ungenaue Tunings hervorragend.

Die kleinen Tricks

Falls der aufgenommene Gesang tendenziell etwas trockener ist, also wenig Raumanteil besitzt, fallen geringe tonale Abweichungen schnell unangenehm auf. Um eine überambitionierte Korrektur zu vermeiden, macht es Sinn, die Gesangsspur mit einer Prise Hall abzuhören.

Wessen Ohren in Bezug auf die Analyse tonaler Ungenauigkeiten noch nicht so viel Übung haben, der findet beispielsweise Unterstützung in Form von “Tuner” Plug-ins des Host-Programms. Weiterhin ist es immer praktisch, ein (vom Host Programm unabhängiges) Keyboard oder eine vergleichbare App (Synth, Sampler) zum autarken Abspielen von Referenz-Noten parat zu haben.

Mittlerweile gibt es kaum noch einen Hersteller von Audiosoftware, der kein Programm oder Plug-in zur Tonhöhenkorrektur anbietet. Im Folgenden beschreibe ich meine Vorgehensweise mit Celemony Melodyne und Antares Auto-Tune, die methodisch aber auch mit anderer Software durchführbar ist.

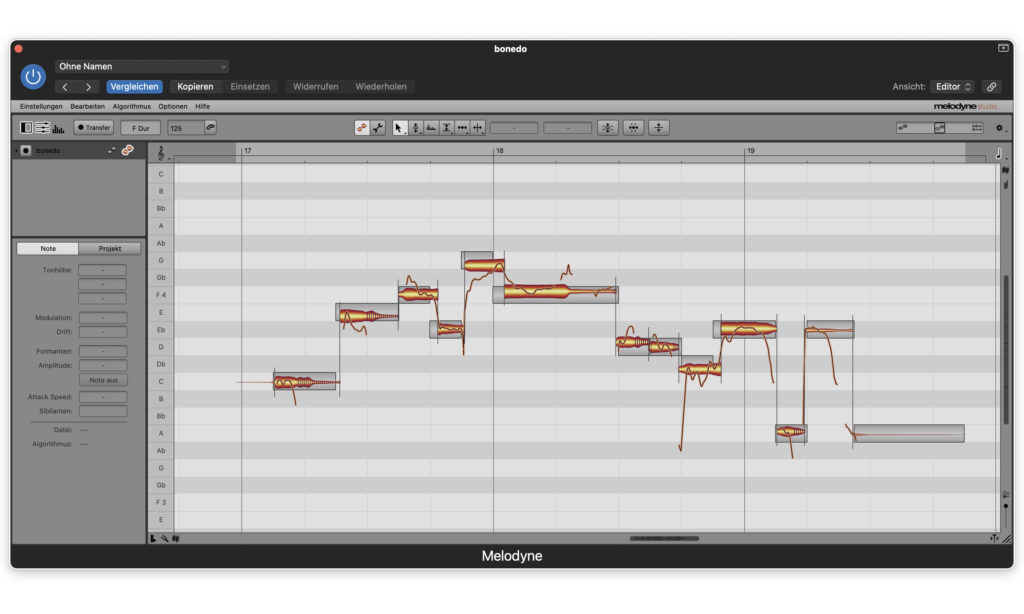

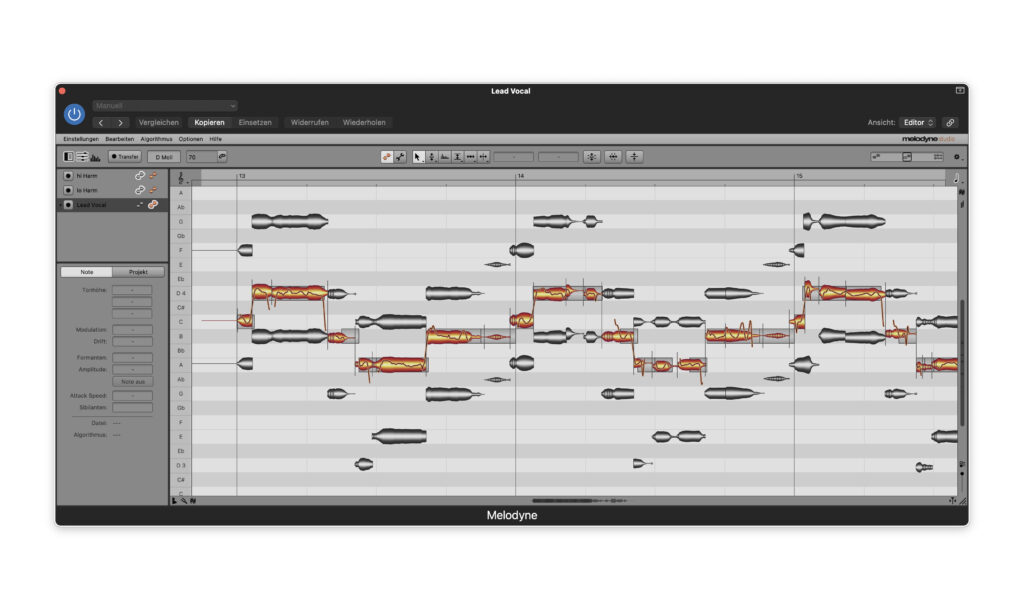

Supertool zur Pitch Correction von Vocal-Tracks: Melodyne

Der erste Schritt zur Bearbeitung mit Melodyne ist das “Aufnehmen” des Audiomaterials im insertierten Plug-in. Sobald dies geschehen ist, wird der unbearbeitete Gesang automatisch nach Tonhöhe und zeitlichem Ablauf analysiert und in einer Art und Weise dargestellt, die sehr an einen klassischen “Piano Roll Editor” von Sequenzer-Programmen erinnert. Das Schöne daran: Die Gesangsspur lässt sich nun auf die gleiche, eingängige und übersichtliche Weise bearbeiten!

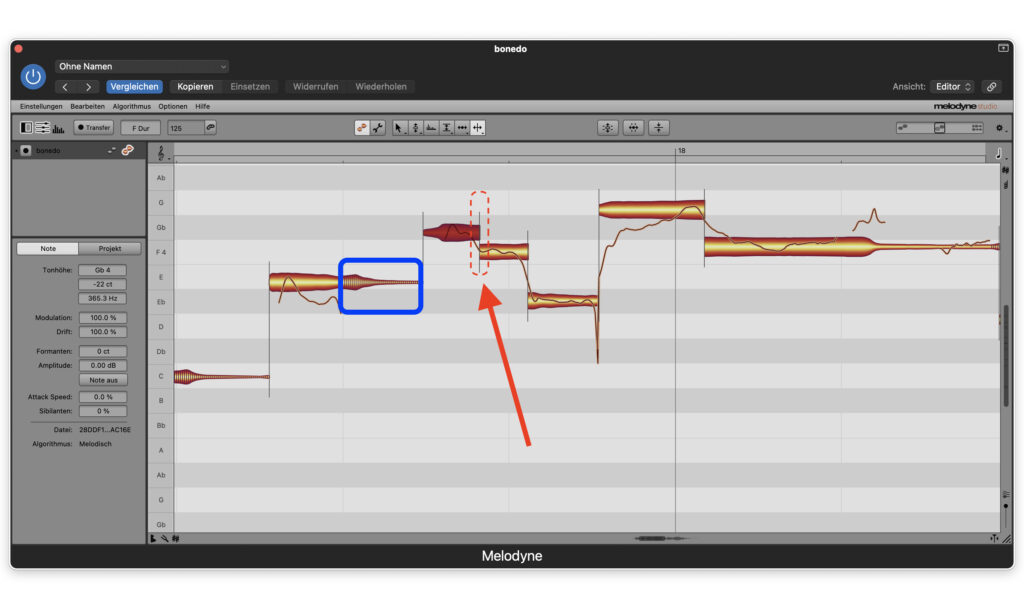

In den folgenden Abbildungen ist zu erkennen, wie das Material nach dieser Analyse aussieht. Der dicke, orangefarbene Bereich (“Blob”) entspricht in der Regel der durchschnittlichen Tonhöhe einer gesungenen Note. Weiterhin ist eine feine rote Linie zu erkennen, die auch manchmal den Blob verlässt. Diese Linie markiert den exakten Tonhöhenverlauf des Gesangs, so lassen sich z.B. Vibratos und Übergänge verschiedener Töne detailliert verfolgen und auch bearbeiten.

Es ist sehr häufig sinnvoll, Abweichungen der exakten Tonhöhe vom Blob als eigenen Ton zu betrachten. Aus diesem Grund füge ich mit dem entsprechenden Schneidewerkzeug weitere Notentrennungen ein und auch bei langen Noten bietet eine Separierung und Bearbeitung entsprechend dem exakten Tonhöhenverlauf Vorteile.

Tipp: Atmer und stimmlose Konsonanten sollten vor der Bearbeitung ebenfalls separiert werden, um Artefakten vorzubeugen. Aktuelle Melodyne-Versionen erkennen derartige Abschnitte inzwischen aber automatisch.

Nicht übertreiben

Auch wenn es das Ziel ist, dem Zuhörer ein absolut authentisch und natürlich klingendes Ergebnis zu liefern, entgeht kaum eine Silbe der Tonhöhenbearbeitung. Das bedeutet NICHT, dass jeder Cent Abweichungen vom Zielton korrigiert werden muss! Je nach Musikstil klingen gewisse Ungenauigkeiten im richtigen Maß am authentischsten, wie diese aber dosiert werden, wird von Silbe zu Silbe entschieden, quasi designt.

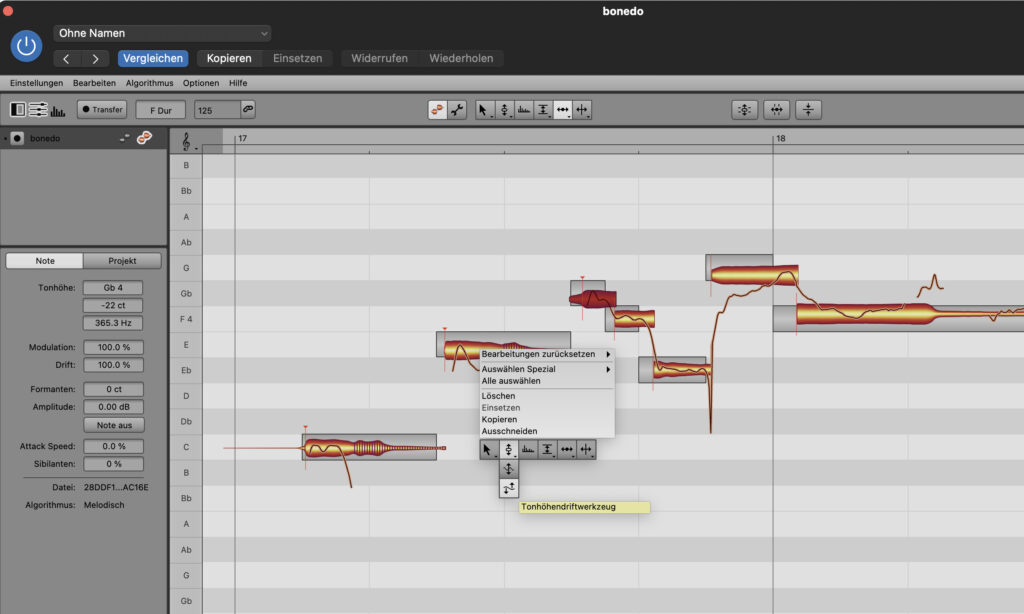

Ähnlich wie bei meiner Vorgehensweise beim Comping setze ich einen ein- oder zweitaktigen Cycle und führe in Melodyne Korrekturen durch. Hierzu bietet Melodyne verschiedene Werkzeuge zur Tonhöhen- und auch Timingkorrektur, welche ich in diesem Arbeitsschritt ebenfalls parallel durchführe.

Der Übersichtlichkeit halber werde ich diesen Punkt an späterer Stelle thematisieren. Im Wesentlichen bearbeite ich die Tonhöhe mit zwei Werkzeugen, eines zum Verschieben der Tonhöhe, das andere zum Verringern (oder auch Erhöhen) der Modulation (Vibrato).

Die Dosis macht das Gift

Durch das Verringern der Modulation erhält man einen etwas moderneren Touch, extreme Einstellungen gleichen dem nicht totzukriegenden Cher-Effekt. Bei sensiblem Material, in welchem erkennbare Artefakte einer Tonhöhenkorrektur ein absolutes No-Go sind, bevorzuge ich für eine notwendige Minimierung von Vibratos eine weitere Segmentierung und gezielte Tonhöhenverschiebung einzelner Bereiche. Der nachfolgende Clip zeigt die elementaren Bearbeitungsmöglichkeiten von Melodyne:

Im folgenden Audiobeispiel sind verschiedene Intensitäten der Reduzierung des Vibratos mit Melodyne zu hören (beginnend bei 0 Prozent, was dem erwähnten Effekt entspricht, gefolgt von 25, 50, 75 und 100 Prozent, also der unbearbeiteten Modulation).

Wenn der Gesangspart dann komplett mit Melodyne bearbeitet ist, bounce ich auch hier ein neues Audiofile. Obwohl ich bereits unzählige Gesänge bearbeitet und “gepitcht” habe, ist es während dieses Arbeitsschritts immer wieder schwierig zu beurteilen, ob man es mit der Korrektur an einigen Stellen vielleicht etwas übertrieben und an anderen zu wenig korrigiert hat.

Blöd ist es, wenn man in der finalen Mix-Situation bemerkt, dass eine Stelle unnatürlich akkurat klingt. Aus diesem Grund gehe ich manchmal folgendermaßen vor: “Im Zweifel für den Angeklagten”. Damit meine ich, dass man bei Unsicherheiten die Korrektur der Tonhöhe mit Melodyne auf das Notwendigste beschränkt und gegebenenfalls im weiteren Produktionsverlauf nachbessert oder alternative Versionen bounct.

Tipp: Am besten alternative Versionen bouncen – hierzu nutze ich Antares Auto-Tune.

Die ARA-Schnittstelle zur Verzahnung von Melodyne (wie auch anderen kompatiblen Plugins) und dem Hostprogramm darf an dieser Stelle nicht unerwähnt bleiben. Allerdings sind die Workflow-Vorteile je nach eingesetztem DAW-Hostprogramm sehr (!) unterschiedlich. Absolut gelungen ist die Umsetzung in den Pro Tools Versionen ab 2022.9.

Automatische Pitch-Correction: Antares Auto-Tune

Ich insertiere oft das Plug-in hinter Melodyne und nutze die automatische Tonhöhenkorrektur. Meistens wähle ich zunächst eine dezente Einstellung (Retune Speed: slow/Tracking: relaxed). Und dann bounce ein neues Audiofile und möglicherweise ein weiteres mit einer etwas intensiveren Einstellung.

Der moderate Einsatz von Auto-Tune hat in etwa die Wirkung von einem “Tonhöhen-Mastering” und ist manchmal das letzte i-Tüpfelchen der Tonhöhenkorrektur. Es hat sich häufig als sehr nützlich erwiesen, verschiedene Optionen der Gesangsspur in der Endphase einer Produktion zur Verfügung zu haben, um partiell nachbessern bzw. einzelne Phrasen, Worte oder Silben austauschen zu können.

Im nächsten Audiobeispiel durchläuft der von Melodyne bereits bearbeitete Gesang eine dezent eingestellte Korrektur in Auto Tune.

Der moderate Einsatz von Auto-Tune hat in etwa die Wirkung von einem “Tonhöhen-Mastering” und ist manchmal das letzte i-Tüpfelchen der Tonhöhenkorrektur. Es hat sich häufig als sehr nützlich erwiesen, verschiedene Optionen der Gesangsspur in der Endphase einer Produktion zur Verfügung zu haben, um partiell nachbessern bzw. einzelne Phrasen, Worte oder Silben austauschen zu können.

Nicht vergessen: Timingkorrektur von Vocal Tracks durchführen

Wie bereits erwähnt, findet dieser wichtige Arbeitsschritt parallel zur Tonhöhenkorrektur in Melodyne statt, wo Änderungen in einer beispiellosen Qualität vorgenommen werden können. Nach meiner Ansicht ist der Endpunkt einer gesungenen Note für einen souveränen Groove fast genauso wichtig wie der Startpunkt.

Beides kann man in Melodyne mit entsprechenden Werkzeugen bequem anpassen, wodurch gesungene Töne durch Time-Stretching getreckt oder gestaucht werden, was in vielen Fällen bei geringfügigen bis moderaten Änderungen kein Problem ist. Bei intensiveren Korrekturen ist zu beachten, dass Tonhöhenverläufe und Vibratos ebenfalls gestreckt/gestaucht werden, wodurch es bei charakteristischen Ein- und Ausschwingphasen eines Tons sinnvoll sein kann, diese vor der Bearbeitung zu separieren und nur den “tonal unauffälligen” Bereich in seiner Länge zu verändern.

Bei extremen Längenveränderungen von Noten lässt sich mit Schnitten des Audiomaterials häufig ein natürlicher klingendes Ergebnis erzielen.

Im folgenden Audiobeispiel hört man das Wort “see” zunächst unbearbeitet, gefolgt von einer Verlängerung per Time-Stretch und manuellem Schnitt.

Die richtigen Entscheidungen bezüglich des Timings zu treffen, ist fast noch schwieriger, als das optimale Tuning zu treffen. Hier ist es wichtig, die zu bearbeitende Stelle im übergeordneten Kontext zu hören. Mit etwas Abstand erschließt sich häufig weiterer Optimierungsbedarf, was aber in der Regel durch einfache Schnitte korrigierbar ist.

Nachbearbeitung von Backing Vocals

Prinzipiell folgt die komplette Nachbearbeitung von Dopplungen, Harmonies und weiteren Backing-Elementen den gleichen Regeln, die ich beim Editieren der Lead Vocal anwende. Nur ein weiteres wichtiges Kriterium kommt hinzu: Die einzelnen Backing-Spuren müssen gut zur Lead Vocal passen!

Obwohl der Sinn von beispielsweise Dopplungsspuren darin liegt, dass durch tonale und zeitliche Abweichungen der gesamte Gesangssound voller und wärmer klingt, ist der Sweet Spot von unterschiedlichem Microtuning und -timing doch sehr begrenzt. Sehr schnell führt das Hinzufügen unpräziser Backing-Elemente zu einem verwaschenen Höreindruck. Auch die Sprachverständlichkeit leidet unter clusterähnlich auftretenden Konsonanten – besonders in der deutschen Sprache. Doch was nicht passt, wird eben passend gemacht!

Obwohl es hierfür spezielle Programme wie VocALign, VocAlign Ultra und Revoice Pro (alle drei Programme von Synchro Arts) gibt, mit denen die erforderlichen Anpassungen der Backing-Spuren mittels Time-Stretching in vielen Fällen schnell und zufriedenstellend vollzogen sind, kommt auch immer wieder Handarbeit zum Einsatz.

VocAlign Ultra ermöglicht die automatische Angleichung von Timing und Tonhöhe verschiedener Takes.

Unterschiede je nach DAW

Das kann mit Logic unter Umständen zur Qual werden, mit Programmen wie Pro Tools oder Cubase kann man dies aber zügig und präzise erledigen. Aber der Reihe nach, was ist zu tun und zu beachten?

Die Lead Vocal ist der Boss! Dementsprechend muss man beim Comping der einzelnen Backing-Spuren auch die Lead Vocal hören, um beurteilen zu können, ob sich z.B. ein Dopplungs-Take für die Produktion eignet. Hierzu verteile ich beide Spuren etwas im Stereo-Panorama, was die Analyse und Erkenntnis erleichtert.

Häufig stellt man fest, dass Konsonanten, speziell Konsonanten am Ende eines Wortes, selten synchron sind. Der einfachste Weg wäre es, diese in der Dopplung wegzuschneiden – ich empfehle auslautende (also am Wortende) und freistehende Konsonanten per Schnitt synchron zur Lead Vocal anzulegen, was nicht viel aufwendiger ist und sich im Laufe der Produktion als Vorteil erweisen kann.

Generell sollte man die Wellenform der Lead Vocal als Hüllkurve betrachten, welche man per Schnitt, Schieben und “Versatz” (Verschieben von Audiomaterial innerhalb einer Audioregion, siehe folgende Abbildung) auf die einzelnen Dopplungsspuren überträgt. Im Gegensatz zu meiner Vorgehensweise bei Konsonanten, säubere ich Backing-Spuren meistens von Gesangspausen inklusive Atmern, welche sich im Endmix erfahrungsgemäß als störend erweisen könnten.

Das nachfolgende Audiobeispiel beinhaltet eine Lead-Vocal- und zwei Dopplungsspuren, zunächst unbearbeitet und dann an erforderlichen Stellen “aligned”.

Korrektur von Dopplungen

Bei der Tonhöhenkorrektur von Dopplungsspuren ist zu beachten, dass die ja gewünschte tonale Schwebung innerhalb aller gleichzeitig hörbaren Stimmen nicht unter übertriebenen Eingriffen leidet. Ein synchroner Melodieverlauf zur Lead Vocal inklusive Glides und kleiner “Schlenker” hingegen sollte aber gewährleistet sein, was mit Programmen wie Melodyne problemlos umzusetzen ist.

Melodyne Studio ermöglicht das übersichtliche Editieren von Dopplungs- und Hamoniespuren.

Die häufig gestellte Frage, wie viele Dopplungen man in der Regel benötigt, lässt sich aufgrund der stilistischen Vielfalt und dem individuell erwünschten Effekt für die Produktion nicht pauschal beantworten. Manche Kollegen verwenden bis zu acht Spuren, um eine Lead Vocal im Refrain zu doppeln; ich bevorzuge in vielen Fällen weniger Spuren, die dafür präziser designt sind.

Ein Sonderfall ist die Emulation eines Chors mit – im Extremfall – nur einem Sänger bzw. Sängerin. Hierzu benötigt man natürlich eine Vielzahl von Stimmen, welche zum Glück nur eine begrenzte Nachbearbeitung erfordern. Das liegt daran, dass sich tonale Abweichungen in der Masse an Gesangsspuren “versenden” und selten störend in Erscheinung treten. Da Chöre klanglich weiter weg in einen Raum eingebettet sin, kommen dementsprechend deutlich weniger hohe Frequenzen beim Zuhörer an. Die Sprachverständlichkeit im Vergleich zur Lead Vocal ist hierbei von geringerer Wichtigkeit. Gleichzeitig wird die Streuung von Konsonanten nur selten als störend empfunden und bedarf somit nur in Ausnahmefällen einer Nachbearbeitung.

Nach diesen Methoden bringe ich alle Gesangsspuren in den “Ready-to-mix-Status” – was beim Mischen von Gesangsspuren zu beachten ist, erfahrt ihr im letzten Teil dieses Workshops!

Burhan Ajrizi sagt:

#1 - 07.05.2018 um 08:57 Uhr

ich möchte ein Song machen

Wellenstrom sagt:

#1.1 - 15.07.2023 um 22:13 Uhr

Dann mach ihn!

Antwort auf #1 von Burhan Ajrizi

Melden Empfehlen Empfehlung entfernenWellenstrom sagt:

#2 - 15.07.2023 um 22:17 Uhr

Für meinen Geschmack 'nen Tacken zu umständlich. Schnippelorgien und Fades kann man sich zu mindestens 90% sparen, wenn man Melodyne nutzt. Artefakte und diverses anderes um die Vox lässt sich in dann aller Regel direkt per Mausclick löschen.